Ejecutar modelos de Inteligencia Artificial (IA) sin censura de forma local (en tu propio ordenador) garantiza total privacidad, libertad de expresión sin restricciones ideológicas y control total sobre tus datos. A principios de 2026, los modelos basados en Dolphin y variantes «abliteradas» (sin capas de seguridad) son los líderes en este espacio.

Aquí tienes una guía de los mejores modelos, herramientas y el hardware recomendado:

1. Mejores Modelos de IA sin Censura (Actualizado 2026)

- Serie Dolphin (Dolphin 3 / Dolphin-Mixtral / Dolphin-Llama3): Desarrollados por Eric Hartford, son los modelos «sin censura» más populares. Están entrenados para no rechazar instrucciones y responder de manera directa.

- Qwen3 (235B/32B/7B): La serie Qwen3 es altamente capaz y presenta variantes «un-censored» (sin censura) que funcionan muy bien en local, destacando por su gran razonamiento.

- Abliterated Models (GLM-4V, etc.): Modelos a los que se les ha eliminado matemáticamente la «capa de seguridad» o censura, ofreciendo respuestas sin filtros.

- Llama 3 Uncensored: Variantes de Llama 3 (como BabyDolphin-8B-LLaMA3) que han sido ajustadas para eliminar las restricciones por defecto de Meta.

2. Herramientas para Ejecutar Modelos en Local

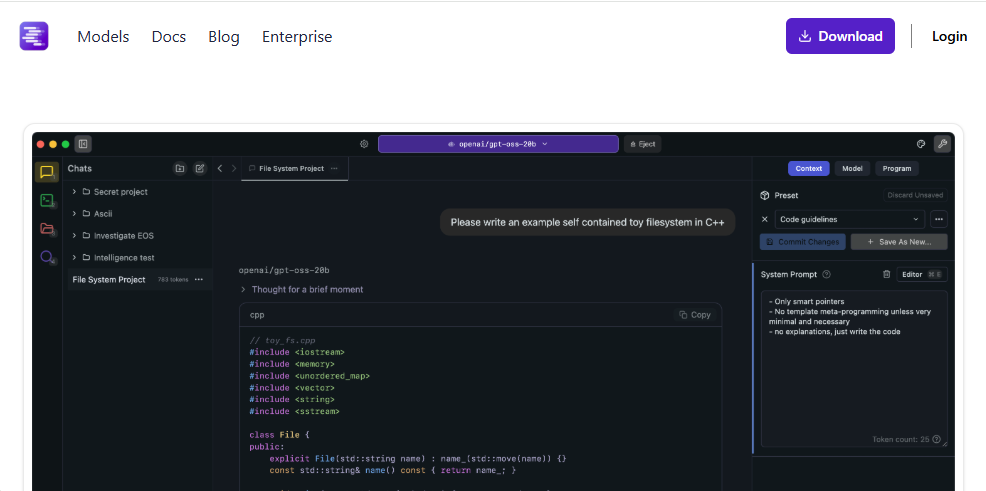

- LM Studio: La opción más fácil e intuitiva. Permite buscar modelos en Hugging Face (como

dolphin-llama3), descargarlos y chatear con ellos con una interfaz tipo ChatGPT. - Ollama: Muy popular para desarrolladores, permite ejecutar modelos mediante línea de comandos o integrarlo en otras aplicaciones. Es rápido y eficiente.

- GPT4All / Faraday.dev: Opciones centradas en la privacidad que permiten chatear con modelos locales sin salir de la aplicación.

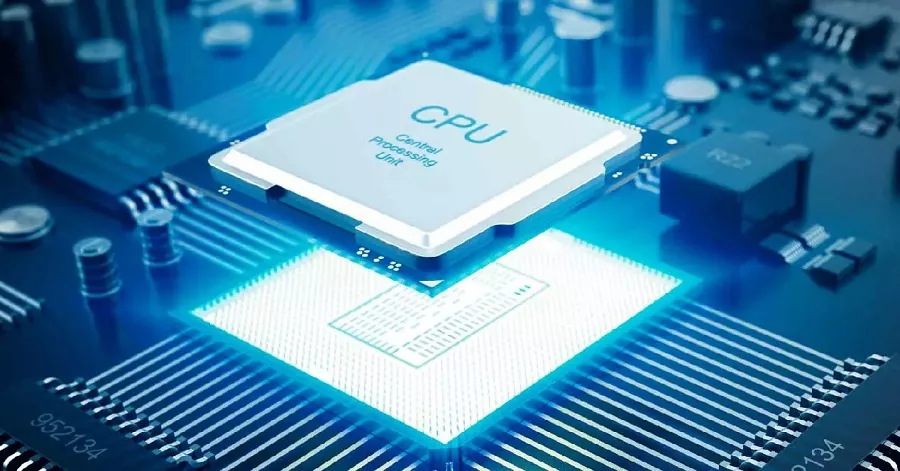

3. Requisitos de Hardware (¿Qué necesitas?)

Para ejecutar modelos de manera fluida, la memoria gráfica (VRAM) es lo más importante:

- Mínimo (modelos 7B/8B): Tarjeta gráfica con al menos 8GB-12GB de VRAM (NVIDIA RTX 3060/4060) o Mac con Apple Silicon (M1/M2/M3/M4) con 16GB RAM.

- Recomendado (modelos 13B-30B o más): 16GB-24GB VRAM (NVIDIA RTX 3090/4090) o Mac Studio/Mini M4 Pro con memoria unificada alta.

4. Dónde encontrar los modelos (Hugging Face)

La mayoría de estos modelos se encuentran en Hugging Face. Busca los siguientes términos:

Dolphin uncensoredAbliteratedLlama 3 uncensored

Resumen de pasos

- Descarga e instala LM Studio o Ollama.

- Busca un modelo, por ejemplo, «Dolphin-2.9-llama3-8b» (generalmente en formato

.ggufpara ordenadores de consumo). - Descarga el modelo (se recomienda versión Q4_K_M o Q5_K_M para buen balance velocidad/calidad).

- Carga el modelo y comienza a chatear sin restricciones.

Nota: Estos modelos pueden generar contenido inapropiado o perturbador, ya que carecen de filtros de seguridad. Úsalos responsablemente.