Introducción al transfer learning para clasificación de imágenes

Cómo crear un modelo de clasificación de imágenes utilizando transfer learning. El aprendizaje de transferencia, o transfer learning en inglés, es una técnica de aprendizaje automático que permite reutilizar modelos pre-entrenados en tareas similares a la tarea original para la que se entrenaron. Esta técnica se utiliza ampliamente en el campo de la clasificación de imágenes.

En la clasificación de imágenes, el objetivo es etiquetar las imágenes en una o más categorías, como perros, gatos, coches, edificios, etc. Para hacer esto, se utilizan modelos de aprendizaje automático que se entrenan en grandes conjuntos de datos de imágenes etiquetadas. Estos modelos pueden ser muy complejos y pueden tardar mucho tiempo en entrenarse.

El transfer learning permite acelerar el proceso de entrenamiento y mejorar la precisión de la clasificación al reutilizar modelos pre-entrenados. Por ejemplo, si se tiene un modelo pre-entrenado para reconocer imágenes de perros y gatos, se puede reutilizar ese modelo para clasificar imágenes de otros animales similares.

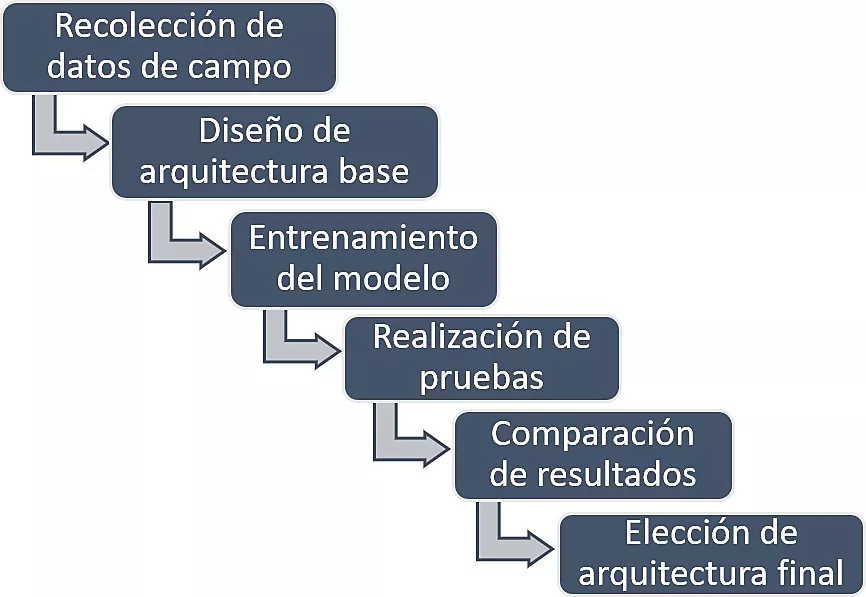

Para aplicar el transfer learning a la clasificación de imágenes, se suelen seguir los siguientes pasos:

- Seleccionar un modelo pre-entrenado que sea adecuado para la tarea de clasificación de imágenes que se desea realizar.

- Ajustar el modelo pre-entrenado para la tarea de clasificación de imágenes específica, es decir, se entrena el modelo en un conjunto de datos de imágenes etiquetadas relacionadas con la tarea específica.

- Evaluar el modelo ajustado y ajustar los hiperparámetros si es necesario.

- Utilizar el modelo ajustado para clasificar nuevas imágenes.

En resumen, el transfer learning es una técnica valiosa para acelerar y mejorar la precisión de la clasificación de imágenes al reutilizar modelos pre-entrenados.

¿Qué es el transfer learning y cómo funciona?

El transfer learning, o aprendizaje de transferencia en español, es una técnica de aprendizaje automático que permite utilizar modelos previamente entrenados en una tarea para resolver otra tarea distinta pero relacionada.

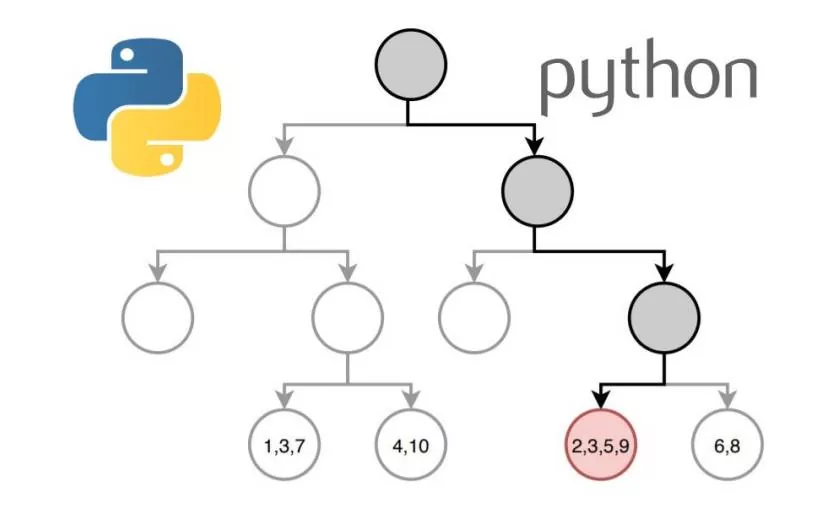

El proceso de transfer learning funciona en tres etapas principales:

- Entrenamiento inicial: Se entrena un modelo de aprendizaje automático en un conjunto de datos grande y diverso para una tarea específica, como la clasificación de imágenes. Durante el entrenamiento, el modelo ajusta los pesos de sus capas para aprender patrones en los datos y así ser capaz de predecir las etiquetas correctas para las imágenes de prueba.

- Extracción de características: Una vez que se ha entrenado el modelo para la tarea original, se extraen las características aprendidas por el modelo en una o varias de sus capas. Estas características son una representación abstracta de las imágenes que el modelo ha aprendido a identificar en el conjunto de datos de entrenamiento.

- Adaptación y finetuning: Finalmente, se adapta el modelo a la nueva tarea ajustando sus capas a un nuevo conjunto de datos relacionados con la tarea en cuestión, como una tarea de clasificación de imágenes diferente. Durante esta fase, las capas del modelo se ajustan con un nuevo conjunto de datos y se les permite volver a aprender a través del proceso de entrenamiento, mientras que las capas extraídas permanecen fijas.

El proceso de transfer learning permite aprovechar el conocimiento y la capacidad de un modelo previamente entrenado para mejorar el rendimiento en una tarea diferente, sin tener que empezar desde cero en el entrenamiento del modelo. Esto puede resultar en un ahorro significativo en tiempo y recursos computacionales, además de obtener mejores resultados en la tarea deseada, especialmente cuando se tienen pocos datos disponibles para entrenar un modelo desde cero.

¿Por qué utilizar transfer learning para clasificación de imágenes?

El transfer learning es una técnica muy útil para la clasificación de imágenes por varias razones:

- Ahorro de tiempo y recursos: Entrenar un modelo de aprendizaje profundo desde cero para la clasificación de imágenes requiere mucho tiempo, recursos y poder computacional, especialmente si se tienen conjuntos de datos grandes y complejos. El transfer learning permite aprovechar modelos pre-entrenados y ajustarlos para una tarea específica, lo que puede ahorrar una cantidad significativa de tiempo y recursos.

- Mejora del rendimiento: Los modelos pre-entrenados tienen una capacidad de generalización mejorada, lo que significa que son capaces de identificar características comunes y relevantes en imágenes de diferentes clases. Utilizando estas características aprendidas en una tarea previa, el modelo puede tener un rendimiento mejorado en la tarea de clasificación de imágenes específica.

- Reutilización de modelos pre-entrenados: Los modelos pre-entrenados se han entrenado en conjuntos de datos grandes y diversos, lo que permite una mejor captura de características generales y abstractas de las imágenes. Estos modelos pueden ser utilizados en diferentes tareas de clasificación de imágenes con sólo ajustar las últimas capas del modelo para adaptarlas a la nueva tarea, en lugar de entrenar un nuevo modelo desde cero.

- Necesidad de conjuntos de datos más pequeños: El uso de modelos pre-entrenados puede reducir la cantidad de datos necesarios para entrenar un modelo, ya que el modelo pre-entrenado ya tiene conocimiento previo de las características relevantes de las imágenes.

En resumen, el transfer learning es una técnica útil para la clasificación de imágenes ya que puede ahorrar tiempo y recursos, mejorar el rendimiento del modelo y reutilizar modelos pre-entrenados en diferentes tareas de clasificación de imágenes.

Preparación de datos para el modelo de transfer learning

La preparación de datos es una de las tareas más importantes y críticas en el proceso de entrenamiento de modelos de transfer learning. Aquí hay algunos pasos generales que se pueden seguir para preparar los datos para un modelo de transfer learning:

- Recopilar datos relevantes: Lo primero que se debe hacer es recopilar los datos que se utilizarán para entrenar el modelo. Es importante asegurarse de que los datos sean relevantes para el problema que se está tratando de resolver y que sean lo suficientemente diversos para evitar el sobreajuste.

- Preprocesamiento de los datos: El preprocesamiento de los datos es una parte importante del proceso de preparación de datos. Esto puede incluir tareas como la limpieza de datos, la normalización de los datos y la selección de características relevantes.

- Dividir los datos en conjuntos de entrenamiento, validación y prueba: Es importante dividir los datos en conjuntos de entrenamiento, validación y prueba para evaluar el rendimiento del modelo y evitar el sobreajuste.

- Carga de datos: Una vez que los datos se han preprocesado y dividido en conjuntos, se deben cargar en el formato adecuado para que el modelo pueda procesarlos. Esto puede incluir la conversión de imágenes a matrices de píxeles y la normalización de los datos.

- Aumento de datos: El aumento de datos es una técnica que se utiliza para aumentar el tamaño del conjunto de datos y mejorar el rendimiento del modelo. Esto puede incluir la rotación, el recorte y la distorsión de las imágenes para crear nuevas imágenes.

- Transferencia de aprendizaje: La transferencia de aprendizaje es la técnica utilizada para transferir el conocimiento adquirido por un modelo previamente entrenado a un nuevo modelo. Esto puede incluir el uso de un modelo previamente entrenado para extraer características relevantes de las imágenes o para inicializar los pesos del modelo.

En resumen, la preparación de datos es una tarea crítica para entrenar modelos de transfer learning. Se deben seguir varios pasos para recopilar, preprocesar y cargar los datos en el formato adecuado para que el modelo pueda procesarlos. Además, técnicas como el aumento de datos y la transferencia de aprendizaje pueden utilizarse para mejorar el rendimiento del modelo.

Selección y recopilación de datos de entrenamiento

La selección y recopilación de datos de entrenamiento es una tarea crucial en el proceso de entrenamiento de modelos de transfer learning. Aquí hay algunos pasos que se pueden seguir para seleccionar y recopilar los datos de entrenamiento adecuados:

- Identificar el problema: Lo primero que se debe hacer es identificar claramente el problema que se está tratando de resolver y las características que se requieren para resolverlo. Esto ayudará a determinar qué datos se necesitan para entrenar el modelo.

- Recopilar datos: Los datos pueden provenir de diversas fuentes, como bases de datos públicas, conjuntos de datos de empresas, redes sociales, entre otros. Es importante asegurarse de que los datos sean relevantes para el problema que se está tratando de resolver y que sean lo suficientemente diversos para evitar el sobreajuste.

- Limpieza de datos: Los datos recopilados pueden contener errores, valores atípicos y ruido. Es importante realizar la limpieza de los datos para eliminar estos elementos y asegurarse de que los datos sean coherentes y precisos.

- Etiquetado de datos: Si los datos no están etiquetados, es necesario etiquetarlos para que el modelo pueda entenderlos. Esto puede incluir tareas como la clasificación de imágenes, la identificación de objetos en imágenes y la anotación de texto.

- División de los datos: Es importante dividir los datos en conjuntos de entrenamiento, validación y prueba para evaluar el rendimiento del modelo y evitar el sobreajuste. Los conjuntos de datos deben ser representativos del conjunto completo de datos y deben tener suficientes muestras para que el modelo pueda generalizar correctamente.

- Aumento de datos: El aumento de datos es una técnica que se utiliza para aumentar el tamaño del conjunto de datos y mejorar el rendimiento del modelo. Esto puede incluir la rotación, el recorte y la distorsión de las imágenes para crear nuevas imágenes.

En resumen, la selección y recopilación de datos de entrenamiento es una tarea crítica para entrenar modelos de transfer learning. Se deben seguir varios pasos para seleccionar y recopilar los datos de entrenamiento adecuados, incluida la limpieza de datos, el etiquetado de datos y la división de los datos en conjuntos de entrenamiento, validación y prueba. Además, técnicas como el aumento de datos pueden utilizarse para mejorar el rendimiento del modelo.

Preprocesamiento y transformación de los datos

El preprocesamiento y la transformación de datos es una parte importante en el entrenamiento de modelos de transfer learning. Aquí hay algunos pasos generales que se pueden seguir para preprocesar y transformar los datos:

- Normalización: La normalización es una técnica que se utiliza para escalar los datos en un rango específico para que el modelo pueda procesarlos. Esto puede incluir la normalización de valores entre 0 y 1 o la estandarización de valores con media cero y desviación estándar uno.

- Reducción de ruido: Los datos pueden contener ruido que puede afectar la precisión del modelo. Es importante eliminar el ruido mediante técnicas como el filtrado o la eliminación de valores atípicos.

- Selección de características: La selección de características es una técnica que se utiliza para seleccionar las características más relevantes para el modelo y eliminar las características irrelevantes. Esto ayuda a reducir el número de características y mejorar el rendimiento del modelo.

- Transformación de datos: La transformación de datos es una técnica que se utiliza para cambiar la forma en que se presentan los datos. Esto puede incluir la conversión de imágenes a matrices de píxeles o la conversión de texto en vectores numéricos.

- Codificación de etiquetas: Si las etiquetas no están codificadas, es necesario codificarlas para que el modelo pueda entenderlas. Esto puede incluir la conversión de etiquetas de texto en valores numéricos.

- Aumento de datos: El aumento de datos es una técnica que se utiliza para aumentar el tamaño del conjunto de datos y mejorar el rendimiento del modelo. Esto puede incluir la rotación, el recorte y la distorsión de las imágenes para crear nuevas imágenes.

En resumen, el preprocesamiento y la transformación de datos son tareas críticas para entrenar modelos de transfer learning. Se deben seguir varios pasos para preprocesar y transformar los datos adecuadamente, incluida la normalización, la reducción de ruido, la selección de características y la transformación de datos. Además, técnicas como la codificación de etiquetas y el aumento de datos pueden utilizarse para mejorar el rendimiento del modelo.

División de datos de entrenamiento, validación y prueba

La división de los datos en conjuntos de entrenamiento, validación y prueba es una tarea importante en el proceso de entrenamiento de modelos de transfer learning. Aquí hay algunos pasos que se pueden seguir para dividir los datos adecuadamente:

- Definir el tamaño de cada conjunto de datos: Lo primero que se debe hacer es definir el tamaño de cada conjunto de datos. El conjunto de entrenamiento suele ser el más grande, mientras que los conjuntos de validación y prueba suelen ser más pequeños. La proporción puede variar dependiendo del tamaño del conjunto de datos original y de la complejidad del problema.

- Mezclar los datos: Antes de dividir los datos, es importante mezclarlos para asegurarse de que estén aleatorizados y no haya ningún patrón específico en los datos que pueda afectar el rendimiento del modelo.

- Dividir los datos: Los datos deben dividirse en conjuntos de entrenamiento, validación y prueba. Por lo general, se utiliza una proporción de 70-15-15 para conjuntos de entrenamiento, validación y prueba, respectivamente.

- Evaluar el rendimiento del modelo: El conjunto de entrenamiento se utiliza para entrenar el modelo, el conjunto de validación se utiliza para ajustar los parámetros del modelo y el conjunto de prueba se utiliza para evaluar el rendimiento del modelo. Es importante asegurarse de que el conjunto de prueba sea lo suficientemente grande y representativo para que el rendimiento del modelo sea preciso.

- Realizar validación cruzada: En algunos casos, puede ser útil realizar validación cruzada en lugar de dividir los datos en conjuntos de entrenamiento, validación y prueba. La validación cruzada implica dividir los datos en k pliegues y entrenar y evaluar el modelo k veces utilizando diferentes combinaciones de pliegues como conjuntos de entrenamiento, validación y prueba.

En resumen, la división de los datos en conjuntos de entrenamiento, validación y prueba es una tarea importante en el proceso de entrenamiento de modelos de transfer learning. Se deben seguir varios pasos para dividir los datos adecuadamente, incluida la definición del tamaño de cada conjunto de datos, la mezcla de los datos y la evaluación del rendimiento del modelo. Además, la validación cruzada puede ser útil en algunos casos.

Creación y entrenamiento del modelo de transfer learning

La creación y entrenamiento del modelo de transfer learning es un proceso crítico en el aprendizaje automático y la inteligencia artificial. Aquí hay algunos pasos que se pueden seguir para crear y entrenar un modelo de transfer learning:

- Selección del modelo base: La selección del modelo base es uno de los primeros pasos en la creación de un modelo de transfer learning. La elección del modelo base dependerá del problema que se esté resolviendo. Es importante seleccionar un modelo base que tenga una arquitectura adecuada para el problema en cuestión.

- Configuración de la arquitectura: Una vez seleccionado el modelo base, se debe configurar la arquitectura del modelo para que se adapte al problema específico. Esto puede incluir la adición de capas adicionales o la modificación de las capas existentes.

- Congelación de las capas: La congelación de las capas es un proceso en el que se establece que ciertas capas del modelo base no se actualizarán durante el entrenamiento. Esto se hace para evitar que se destruya la información de las capas iniciales del modelo base y para reducir el tiempo de entrenamiento.

- Entrenamiento del modelo: Una vez que se ha configurado la arquitectura del modelo y se han congelado las capas adecuadas, se puede comenzar el entrenamiento del modelo. Durante el entrenamiento, se ajustan los pesos de las capas no congeladas en el modelo.

- Ajuste fino del modelo: Después del entrenamiento inicial, es posible realizar ajustes finos en el modelo para mejorar aún más el rendimiento. Esto puede implicar descongelar algunas capas y ajustar sus pesos para adaptarse mejor al problema específico.

- Evaluación del modelo: Una vez que se ha entrenado y ajustado el modelo, es importante evaluar su rendimiento en un conjunto de datos de prueba. Esto permitirá determinar si el modelo es capaz de generalizar y aplicarse a nuevos datos.

En resumen, la creación y entrenamiento de modelos de transfer learning es un proceso complejo que requiere la selección adecuada del modelo base, la configuración de la arquitectura del modelo y la congelación de las capas adecuadas. Una vez que se ha entrenado el modelo, es posible realizar ajustes finos y evaluar el rendimiento del modelo en un conjunto de datos de prueba.

Selección del modelo base preentrenado

La selección del modelo base preentrenado es un paso importante en la creación de un modelo de transfer learning. Aquí hay algunos factores a considerar al seleccionar el modelo base:

- Arquitectura del modelo: La arquitectura del modelo base debe ser adecuada para el problema específico que se está tratando de resolver. Por ejemplo, si se está trabajando en un problema de clasificación de imágenes, es posible que se desee utilizar una red neuronal convolucional como modelo base.

- Tamaño del conjunto de datos: El tamaño del conjunto de datos es un factor importante a considerar al seleccionar el modelo base. Si el conjunto de datos es pequeño, es posible que se desee utilizar un modelo base preentrenado que se haya entrenado en un conjunto de datos similar para aprovechar el conocimiento previo.

- Similaridad del conjunto de datos: La similitud del conjunto de datos es un factor importante a considerar al seleccionar el modelo base. Si el conjunto de datos es similar al conjunto de datos en el que se entrenó el modelo base preentrenado, es más probable que el modelo base preentrenado se adapte bien al problema específico.

- Complejidad del modelo: La complejidad del modelo base preentrenado es otro factor importante a considerar. Si el modelo base preentrenado es demasiado complejo, es posible que se necesite más tiempo y recursos para ajustarlo y entrenarlo para el problema específico.

- Disponibilidad y accesibilidad del modelo: La disponibilidad y accesibilidad del modelo base preentrenado también es un factor importante a considerar. Es posible que se desee utilizar un modelo base preentrenado que ya esté disponible en una biblioteca de aprendizaje automático, o es posible que se desee utilizar uno que sea fácil de obtener y configurar.

En resumen, la selección del modelo base preentrenado es un paso crítico en la creación de un modelo de transfer learning. La arquitectura del modelo, el tamaño y la similitud del conjunto de datos, la complejidad del modelo y la disponibilidad y accesibilidad del modelo son factores importantes a considerar al seleccionar el modelo base preentrenado adecuado.

Adición de capas de clasificación personalizadas

Una vez seleccionado y cargado el modelo base preentrenado, es posible que sea necesario agregar capas de clasificación personalizadas para adaptar el modelo al problema específico que se está resolviendo. Aquí hay algunos pasos que se pueden seguir para agregar capas de clasificación personalizadas:

- Extraer las características del modelo base: Antes de agregar las capas de clasificación personalizadas, es necesario extraer las características del modelo base preentrenado. Esto se puede hacer mediante la eliminación de la última capa de salida del modelo base preentrenado y agregando una capa de «aplanamiento» para convertir los mapas de características en un vector.

- Agregar capas de clasificación personalizadas: Una vez que se han extraído las características del modelo base preentrenado, se pueden agregar capas de clasificación personalizadas. Esto puede incluir capas densas, capas de normalización, capas de dropout, etc. Es importante asegurarse de que las capas de clasificación personalizadas sean adecuadas para el problema específico que se está resolviendo.

- Compilar el modelo: Después de agregar las capas de clasificación personalizadas, es necesario compilar el modelo. Esto implica especificar la función de pérdida, el optimizador y las métricas de evaluación que se utilizarán durante el entrenamiento.

- Entrenar el modelo: Una vez que se ha compilado el modelo, se puede entrenar utilizando el conjunto de datos de entrenamiento. Durante el entrenamiento, se ajustarán los pesos de las capas de clasificación personalizadas agregadas.

- Evaluación del modelo: Después del entrenamiento, es importante evaluar el rendimiento del modelo en un conjunto de datos de prueba. Esto permitirá determinar si el modelo es capaz de generalizar y aplicarse a nuevos datos.

En resumen, la adición de capas de clasificación personalizadas es un paso crítico en la creación de un modelo de transfer learning. Es necesario extraer las características del modelo base preentrenado y agregar capas de clasificación personalizadas adecuadas antes de compilar y entrenar el modelo. Después del entrenamiento, es importante evaluar el rendimiento del modelo en un conjunto de datos de prueba para determinar su capacidad para generalizar y aplicarse a nuevos datos.

Compilación y entrenamiento del modelo

Una vez que se han agregado las capas de clasificación personalizadas al modelo base preentrenado, se puede compilar el modelo y comenzar el entrenamiento. Aquí hay algunos pasos que se pueden seguir para compilar y entrenar el modelo:

- Compilar el modelo: Antes de comenzar el entrenamiento, es necesario compilar el modelo. Esto implica especificar la función de pérdida, el optimizador y las métricas de evaluación que se utilizarán durante el entrenamiento. La elección de la función de pérdida y el optimizador depende del tipo de problema que se está resolviendo. Por ejemplo, para un problema de clasificación binaria, se puede utilizar la función de pérdida «binary_crossentropy» y el optimizador «adam».

- Ajustar el modelo: Después de compilar el modelo, se puede ajustar utilizando el conjunto de datos de entrenamiento. Es importante especificar el número de épocas de entrenamiento y el tamaño del lote (batch size) durante este paso. El número de épocas se refiere al número de veces que se recorre todo el conjunto de datos de entrenamiento durante el entrenamiento, mientras que el tamaño del lote se refiere al número de ejemplos de entrenamiento que se procesan juntos antes de actualizar los pesos del modelo.

- Evaluación del modelo: Después del entrenamiento, es importante evaluar el rendimiento del modelo en un conjunto de datos de prueba. Esto permitirá determinar si el modelo es capaz de generalizar y aplicarse a nuevos datos. Durante la evaluación del modelo, se pueden utilizar métricas de evaluación como la precisión, la recall, la F1-score y la matriz de confusión.

- Ajuste de hiperparámetros: Si el rendimiento del modelo no es satisfactorio, es posible que sea necesario ajustar los hiperparámetros del modelo, como el número de capas ocultas, el número de neuronas por capa oculta, la tasa de aprendizaje, etc. Es importante tener cuidado al ajustar los hiperparámetros, ya que un ajuste incorrecto puede llevar a un sobreajuste (overfitting) o un subajuste (underfitting) del modelo.

En resumen, la compilación y el entrenamiento del modelo son pasos críticos en la creación de un modelo de transfer learning. Es necesario compilar el modelo especificando la función de pérdida, el optimizador y las métricas de evaluación, y luego ajustar el modelo utilizando el conjunto de datos de entrenamiento. Después del entrenamiento, es importante evaluar el rendimiento del modelo en un conjunto de datos de prueba y ajustar los hiperparámetros según sea necesario.

Evaluación del modelo y ajuste de parámetros

Una vez que se ha entrenado el modelo, es importante evaluar su rendimiento en un conjunto de datos de prueba para determinar su capacidad para generalizar a nuevos datos. Esto se puede hacer utilizando varias métricas de evaluación, como la precisión, la recall, la F1-score, la matriz de confusión, el área bajo la curva ROC, etc.

Además, también es importante realizar ajustes en los parámetros del modelo para mejorar su rendimiento. A continuación, se presentan algunos pasos que se pueden seguir para evaluar y ajustar el modelo:

- Evaluar el modelo: Se puede utilizar el conjunto de datos de prueba para evaluar el modelo y calcular las métricas de evaluación. Es importante asegurarse de que el conjunto de datos de prueba sea diferente del conjunto de datos de entrenamiento y validación para evitar el sobreajuste.

- Ajustar los hiperparámetros: Si el rendimiento del modelo no es satisfactorio, es posible que sea necesario ajustar los hiperparámetros del modelo. Los hiperparámetros son parámetros que se establecen antes del entrenamiento y no se ajustan durante el entrenamiento. Ejemplos de hiperparámetros son el número de capas ocultas, el número de neuronas por capa oculta, la tasa de aprendizaje, etc. Es importante ajustar los hiperparámetros cuidadosamente para evitar el sobreajuste.

- Regularización: La regularización es una técnica que se utiliza para evitar el sobreajuste del modelo. Ejemplos de técnicas de regularización son la regularización L1, la regularización L2, la regularización L1-L2, etc. Estas técnicas penalizan los coeficientes de los pesos del modelo para evitar que tengan valores demasiado grandes.

- Data Augmentation: La Data Augmentation es una técnica que se utiliza para aumentar el tamaño del conjunto de datos de entrenamiento mediante la generación de nuevas imágenes a partir de las imágenes existentes. Ejemplos de técnicas de Data Augmentation son la rotación, el zoom, el cambio de brillo, etc. La Data Augmentation puede mejorar el rendimiento del modelo al hacer que el modelo sea más robusto a las variaciones en los datos.

- Ensamblado de modelos: El ensamblado de modelos es una técnica que se utiliza para combinar varios modelos para mejorar el rendimiento. Ejemplos de técnicas de ensamblado de modelos son el Bagging, el Boosting, el Stacking, etc. El ensamblado de modelos puede mejorar el rendimiento del modelo al reducir la varianza y aumentar la precisión.

En resumen, la evaluación y el ajuste de los parámetros son pasos importantes en la creación de un modelo de transfer learning. Es importante evaluar el modelo en un conjunto de datos de prueba y ajustar los hiperparámetros, utilizar técnicas de regularización y Data Augmentation, y considerar el ensamblado de modelos para mejorar el rendimiento del modelo.

Implementación del modelo de clasificación de imágenes

Para implementar un modelo de clasificación de imágenes utilizando transfer learning, se pueden seguir los siguientes pasos:

- Selección del modelo base preentrenado: Se debe seleccionar un modelo base preentrenado que sea adecuado para el problema que se desea resolver. Algunos de los modelos más utilizados son VGG, ResNet, Inception y MobileNet.

- Descarga del modelo base preentrenado: El siguiente paso es descargar el modelo base preentrenado y sus pesos. Esto se puede hacer utilizando una biblioteca de aprendizaje profundo como TensorFlow o PyTorch.

- Adición de capas de clasificación personalizadas: A continuación, se deben agregar capas de clasificación personalizadas al modelo base preentrenado. Esto se puede hacer agregando capas densas y/o capas de dropout. Las capas densas se utilizan para reducir la dimensionalidad de los datos y las capas de dropout se utilizan para reducir el sobreajuste.

- Compilación del modelo: Una vez que se han agregado las capas de clasificación personalizadas, se debe compilar el modelo. Esto se puede hacer utilizando una función de compilación que especifique la función de pérdida, el optimizador y las métricas de evaluación.

- Entrenamiento del modelo: El siguiente paso es entrenar el modelo utilizando un conjunto de datos de entrenamiento. Durante el entrenamiento, se deben ajustar los pesos de las capas del modelo para minimizar la función de pérdida.

- Evaluación del modelo: Una vez que se ha entrenado el modelo, se debe evaluar su rendimiento utilizando un conjunto de datos de prueba. Esto se puede hacer utilizando varias métricas de evaluación, como la precisión, la recall, la F1-score, etc.

- Ajuste de los parámetros: Si el rendimiento del modelo no es satisfactorio, se pueden ajustar los hiperparámetros del modelo. Esto puede incluir ajustar la tasa de aprendizaje, el número de capas ocultas, el número de neuronas por capa, etc.

- Implementación del modelo en producción: Una vez que se ha entrenado y evaluado el modelo, se puede implementar en producción. Esto puede incluir la integración del modelo en una aplicación web o móvil o su implementación en un sistema de procesamiento de imágenes en tiempo real.

En resumen, la implementación de un modelo de clasificación de imágenes utilizando transfer learning requiere la selección de un modelo base preentrenado, la adición de capas de clasificación personalizadas, la compilación y el entrenamiento del modelo, la evaluación del rendimiento del modelo y el ajuste de los parámetros. Una vez que se ha completado este proceso, el modelo puede ser implementado en producción.

Carga y preprocesamiento de imágenes de entrada

Antes de utilizar imágenes como entrada para un modelo de clasificación de imágenes, es necesario realizar algunos pasos de preprocesamiento. Estos pasos pueden incluir:

- Carga de imágenes: Primero, se deben cargar las imágenes que se utilizarán como entrada para el modelo. Esto se puede hacer utilizando una biblioteca de procesamiento de imágenes como OpenCV o Pillow.

- Redimensionamiento de imágenes: Es posible que las imágenes que se carguen no tengan el mismo tamaño que el modelo espera como entrada. Por lo tanto, es importante redimensionar las imágenes para que tengan el tamaño adecuado. El tamaño adecuado puede depender del modelo que se esté utilizando.

- Normalización de imágenes: También es importante normalizar las imágenes para que tengan una escala común y se puedan comparar con otras imágenes. La normalización puede incluir la escala de los valores de píxeles entre 0 y 1 o entre -1 y 1.

- Ampliación de datos: A veces, el conjunto de datos puede ser limitado, por lo que se puede utilizar técnicas de aumento de datos para aumentar la cantidad de imágenes de entrada. Estas técnicas pueden incluir la rotación, el recorte, la reflexión, el cambio de brillo y el cambio de contraste.

- Creación de lotes de datos: Para mejorar la eficiencia del procesamiento, es común crear lotes de datos de entrada en lugar de procesar cada imagen de forma individual. Los lotes pueden ser de diferentes tamaños y se pueden utilizar para entrenar o evaluar el modelo.

En resumen, antes de utilizar imágenes como entrada para un modelo de clasificación de imágenes, es necesario realizar algunos pasos de preprocesamiento, como la carga de imágenes, el redimensionamiento, la normalización, la ampliación de datos y la creación de lotes de datos. Estos pasos son importantes para garantizar que el modelo reciba datos de entrada consistentes y que pueda procesarlos de manera eficiente.

Clasificación y etiquetado de imágenes de entrada

La clasificación y el etiquetado de imágenes son pasos importantes para la creación de un modelo de clasificación de imágenes preciso y efectivo.

La clasificación se refiere al proceso de asignar una etiqueta o categoría a una imagen. Por ejemplo, si estamos trabajando en un modelo de clasificación de imágenes de perros y gatos, la clasificación implicaría determinar si una imagen es de un perro o de un gato.

El etiquetado se refiere al proceso de agregar metadatos a una imagen, como descripciones, nombres y etiquetas que indiquen características específicas de la imagen. Por ejemplo, para una imagen de un perro, se podrían agregar etiquetas que indiquen su raza, tamaño, color, etc.

La clasificación y el etiquetado de imágenes se pueden realizar de manera manual o automatizada. En el caso de la clasificación manual, los seres humanos revisan cada imagen y determinan la categoría a la que pertenece. Este proceso puede ser laborioso y requiere tiempo y recursos considerables. Sin embargo, puede ser esencial para garantizar que las etiquetas sean precisas y útiles para el modelo.

Por otro lado, el etiquetado automatizado utiliza algoritmos para asignar etiquetas a las imágenes. Esto puede incluir técnicas de aprendizaje profundo, como la clasificación de imágenes basada en características, donde un modelo identifica patrones y características en las imágenes para determinar su etiqueta. El etiquetado automatizado es más rápido y eficiente, pero puede ser menos preciso que la clasificación manual.

En general, la clasificación y el etiquetado de imágenes son procesos críticos para la creación de un modelo de clasificación de imágenes preciso y efectivo. Dependiendo de los recursos disponibles y los objetivos del proyecto, se puede optar por la clasificación y el etiquetado manual o automatizado, o una combinación de ambos.

Mejoras y optimizaciones del modelo de transfer learning

Existen varias mejoras y optimizaciones que se pueden aplicar a un modelo de transfer learning para mejorar su precisión y eficiencia. Aquí hay algunas sugerencias:

- Ajuste fino (fine-tuning): Una técnica común de transfer learning es ajustar finamente el modelo preentrenado para que se adapte a los datos específicos de un problema. En lugar de entrenar todo el modelo desde cero, se pueden ajustar los pesos de las capas superiores del modelo preentrenado para que se ajusten mejor a los datos de entrenamiento específicos. Esto puede mejorar significativamente la precisión del modelo.

- Cambio de función de activación: Las funciones de activación pueden afectar significativamente el rendimiento de un modelo. Por ejemplo, la función ReLU puede funcionar mejor en algunas situaciones que la función sigmoidal. Experimentar con diferentes funciones de activación puede mejorar el rendimiento del modelo.

- Cambio de optimizador: El optimizador utilizado para ajustar los pesos del modelo también puede afectar su rendimiento. Por ejemplo, el optimizador Adam puede ser más efectivo en algunos casos que el optimizador SGD. Probar diferentes optimizadores puede ayudar a encontrar la mejor opción para el modelo.

- Agregar más capas: Añadir capas adicionales al modelo puede mejorar su capacidad para aprender patrones complejos. Sin embargo, agregar demasiadas capas puede llevar a un sobreajuste (overfitting) y empeorar el rendimiento. Por lo tanto, se recomienda experimentar con diferentes arquitecturas de capas para encontrar la mejor opción para el modelo.

- Aumento de datos: La técnica de aumento de datos (data augmentation) puede aumentar la cantidad de datos de entrenamiento disponibles, lo que puede mejorar la precisión del modelo. La técnica implica realizar transformaciones en las imágenes de entrenamiento existentes, como rotación, cambio de escala, cambio de brillo, etc.

- Selección de un modelo preentrenado diferente: No todos los modelos preentrenados son igualmente adecuados para todos los problemas. Probar diferentes modelos preentrenados y encontrar el que mejor se adapte al problema en cuestión puede mejorar el rendimiento del modelo.

En resumen, hay varias mejoras y optimizaciones que se pueden aplicar a un modelo de transfer learning, incluyendo ajuste fino, cambio de función de activación, cambio de optimizador, agregar más capas, aumento de datos y selección de un modelo preentrenado diferente. Probar diferentes técnicas y ajustar los parámetros del modelo pueden ayudar a mejorar significativamente la precisión y eficiencia del modelo.

Ajuste de hiperparámetros para mejorar el rendimiento

Además de las mejoras y optimizaciones del modelo de transfer learning que se mencionaron anteriormente, ajustar los hiperparámetros también puede mejorar significativamente el rendimiento del modelo. Los hiperparámetros son variables que no se aprenden directamente durante el entrenamiento del modelo, pero que afectan su comportamiento y rendimiento.

Algunos hiperparámetros importantes que se pueden ajustar para mejorar el rendimiento del modelo incluyen:

- Tasa de aprendizaje (learning rate): La tasa de aprendizaje determina cuánto se ajustan los pesos del modelo en función del error de entrenamiento. Una tasa de aprendizaje demasiado alta puede provocar que el modelo se salte el mínimo global y no pueda converger. Por otro lado, una tasa de aprendizaje demasiado baja puede provocar que el modelo tarde demasiado en converger o se atasque en un mínimo local. Por lo tanto, encontrar la tasa de aprendizaje adecuada es esencial para optimizar el rendimiento del modelo.

- Tamaño del lote (batch size): El tamaño del lote determina cuántas muestras se utilizan en cada iteración del entrenamiento. Un tamaño de lote más grande puede aumentar la velocidad del entrenamiento, pero puede hacer que el modelo sea menos estable y empeorar su precisión. Por otro lado, un tamaño de lote más pequeño puede aumentar la precisión del modelo, pero puede ralentizar el entrenamiento.

- Número de épocas (epochs): El número de épocas determina cuántas veces se itera a través de todo el conjunto de datos de entrenamiento. Demasiadas épocas pueden provocar que el modelo se sobreajuste a los datos de entrenamiento, mientras que demasiado pocas épocas pueden provocar que el modelo no aprenda lo suficiente.

- Regularización: La regularización es una técnica que puede ayudar a prevenir el sobreajuste. Hay varias formas de regularización, como la regularización L1, L2 y Dropout. Estas técnicas pueden ayudar a reducir la complejidad del modelo y mejorar su capacidad para generalizar a datos nuevos.

- Número de unidades en las capas ocultas: El número de unidades en las capas ocultas puede afectar significativamente el rendimiento del modelo. Demasiadas unidades pueden provocar que el modelo sea demasiado complejo y propenso al sobreajuste, mientras que demasiado pocas unidades pueden hacer que el modelo sea demasiado simple y no pueda capturar patrones complejos en los datos.

- Función de pérdida (loss function): La función de pérdida determina cómo se mide el error del modelo durante el entrenamiento. La elección de la función de pérdida adecuada puede mejorar el rendimiento del modelo al asegurarse de que se optimice la métrica adecuada.

En resumen, ajustar los hiperparámetros puede ser una forma efectiva de mejorar el rendimiento del modelo de transfer learning. Algunos hiperparámetros importantes que se pueden ajustar incluyen la tasa de aprendizaje, el tamaño del lote, el número de épocas, la regularización, el número de unidades en las capas ocultas y la función de pérdida. Experimentar con diferentes valores de hiperparámetros y encontrar la combinación óptima puede mejorar significativamente la precisión y eficiencia del modelo.

Aumento de datos para mejorar la precisión del modelo

El aumento de datos (data augmentation) es una técnica utilizada para aumentar el tamaño del conjunto de datos de entrenamiento, generando nuevas muestras a partir de las ya existentes, mediante transformaciones que no cambian la etiqueta de la muestra.

Esta técnica es especialmente útil en problemas de clasificación de imágenes, donde el aumento de datos puede mejorar significativamente el rendimiento del modelo al proporcionar más variedad de imágenes y reducir el sobreajuste.

Algunas transformaciones comunes utilizadas en el aumento de datos incluyen:

- Rotación: Girar la imagen en un ángulo aleatorio para simular diferentes ángulos de captura.

- Traslación: Desplazar la imagen en una dirección aleatoria para simular diferentes posiciones en la imagen.

- Escalado: Redimensionar la imagen en un factor aleatorio para simular diferentes distancias de la cámara.

- Volteo horizontal: Voltear la imagen horizontalmente para simular diferentes orientaciones.

- Cambio de brillo: Ajustar el brillo de la imagen para simular diferentes condiciones de iluminación.

- Recorte aleatorio: Recortar una sección aleatoria de la imagen para simular diferentes campos de visión.

Al aplicar estas transformaciones a las imágenes del conjunto de datos de entrenamiento, se pueden crear nuevas imágenes que son diferentes de las originales, pero que aún representan la misma clase. Esto aumenta la diversidad del conjunto de datos de entrenamiento y ayuda al modelo a generalizar mejor a nuevas imágenes.

Es importante destacar que el aumento de datos no debe aplicarse al conjunto de validación o prueba, ya que las transformaciones pueden introducir sesgos en las evaluaciones del modelo.

En resumen, el aumento de datos es una técnica poderosa para mejorar la precisión del modelo al aumentar la diversidad del conjunto de datos de entrenamiento y reducir el sobreajuste. Al aplicar transformaciones comunes como rotación, traslación, escalado, volteo horizontal, cambio de brillo y recorte aleatorio, se pueden crear nuevas imágenes que simulan diferentes condiciones de captura y mejorar el rendimiento del modelo.

Conclusión y próximos pasos

En conclusión, el transfer learning es una técnica de aprendizaje automático muy efectiva para la clasificación de imágenes, que aprovecha el conocimiento previo de modelos pre-entrenados para mejorar el rendimiento del modelo. El proceso de implementación del modelo de transfer learning implica la selección del modelo base, la adición de capas de clasificación personalizadas, la compilación y entrenamiento del modelo, la evaluación y ajuste de los parámetros.

Además, el aumento de datos es una técnica poderosa que se puede utilizar para mejorar aún más el rendimiento del modelo, al aumentar la diversidad del conjunto de datos de entrenamiento y reducir el sobreajuste.

En cuanto a los próximos pasos, una vez que se ha construido el modelo de transfer learning y se ha optimizado su rendimiento, se puede aplicar en un proyecto real, donde se utilice para clasificar imágenes y extraer información útil. También se pueden explorar otras técnicas de aprendizaje automático para problemas de clasificación de imágenes, como las redes neuronales convolucionales (CNN) y las redes adversarias generativas (GAN), para mejorar aún más la precisión y el rendimiento del modelo.

Recapitulación de los pasos para crear un modelo de clasificación de imágenes con transfer learning

A continuación, se presenta una recapitulación de los pasos necesarios para crear un modelo de clasificación de imágenes con transfer learning:

- Seleccionar el modelo base pre-entrenado adecuado.

- Cargar y preparar los datos de entrenamiento, validación y prueba.

- Adicionar capas de clasificación personalizadas al modelo base pre-entrenado.

- Compilar y entrenar el modelo, utilizando el conjunto de datos de entrenamiento y validación.

- Evaluar el rendimiento del modelo en el conjunto de prueba y ajustar los parámetros del modelo si es necesario.

- Implementar el modelo en un proyecto real y aplicarlo a la clasificación de imágenes.

- Opcionalmente, aplicar técnicas de aumento de datos para mejorar aún más el rendimiento del modelo.

Es importante destacar que el proceso de creación de un modelo de clasificación de imágenes con transfer learning es iterativo y requiere de experimentación y ajuste para lograr el mejor rendimiento posible.

Sugerencias para mejorar y expandir el modelo

Aquí hay algunas sugerencias para mejorar y expandir el modelo de transfer learning:

- Aumentar el tamaño del conjunto de datos de entrenamiento: El modelo puede mejorar si se alimenta con más datos de entrenamiento. Se pueden encontrar conjuntos de datos públicos o recopilar datos de imágenes específicas para el problema que se está abordando.

- Ajustar la arquitectura del modelo: Si el modelo no está produciendo los resultados deseados, se pueden ajustar las capas ocultas y las unidades de neuronas para mejorar la precisión.

- Experimentar con diferentes modelos pre-entrenados: Hay muchos modelos pre-entrenados disponibles y se pueden probar diferentes opciones para ver cuál funciona mejor para el problema específico.

- Utilizar técnicas de aumento de datos: Para mejorar la capacidad del modelo para generalizar y reducir el sobreajuste, se pueden utilizar técnicas de aumento de datos como la rotación, el cambio de escala, el corte, la inversión y la modificación de la intensidad.

- Utilizar técnicas de regularización: Se pueden utilizar técnicas de regularización, como la disminución del peso, el abandono y la normalización por lotes para reducir el sobreajuste.

- Utilizar la transferencia de aprendizaje para otros problemas: Una vez que se ha creado un modelo exitoso, se puede utilizar la transferencia de aprendizaje para otros problemas de clasificación de imágenes, lo que ahorra tiempo y recursos.

- Utilizar múltiples modelos: Si hay varios tipos de imágenes que se están clasificando, se pueden utilizar múltiples modelos para mejorar la precisión en cada categoría.

Estas son algunas sugerencias para mejorar y expandir el modelo de transfer learning, pero en última instancia, el proceso de mejora es iterativo y requiere experimentación y ajuste.

Implementación en un proyecto práctico

Una vez que se ha entrenado y evaluado el modelo de transfer learning, se puede implementar en un proyecto práctico para clasificar imágenes. Aquí hay algunos pasos que se pueden seguir para implementar el modelo en un proyecto real:

- Configurar el entorno de desarrollo: Se debe instalar la biblioteca de aprendizaje profundo, cargar el modelo pre-entrenado y cualquier otro software necesario para ejecutar el modelo.

- Preprocesamiento de las imágenes de entrada: Se deben preprocesar las imágenes de entrada para asegurarse de que sean del tamaño adecuado y estén en el formato correcto para ser clasificadas por el modelo.

- Clasificación de imágenes: Se debe ejecutar el modelo para clasificar las imágenes de entrada y generar una salida que indique la clase de cada imagen.

- Presentación de resultados: Se deben presentar los resultados de la clasificación de imágenes de una forma comprensible para los usuarios del proyecto. Esto podría incluir la presentación de las imágenes clasificadas junto con sus etiquetas correspondientes.

- Optimización del rendimiento: Se deben realizar ajustes para optimizar el rendimiento del modelo en el proyecto específico. Esto podría incluir el ajuste de los hiperparámetros, el aumento de datos o la selección de un modelo diferente.

- Integración en el flujo de trabajo del proyecto: El modelo de clasificación de imágenes debe integrarse en el flujo de trabajo del proyecto, lo que podría incluir la creación de una interfaz de usuario, la automatización de la clasificación de imágenes o la integración con otras herramientas y sistemas.

En general, la implementación de un modelo de transfer learning en un proyecto práctico es un proceso iterativo que puede requerir ajustes y mejoras continuas para lograr el mejor rendimiento posible.