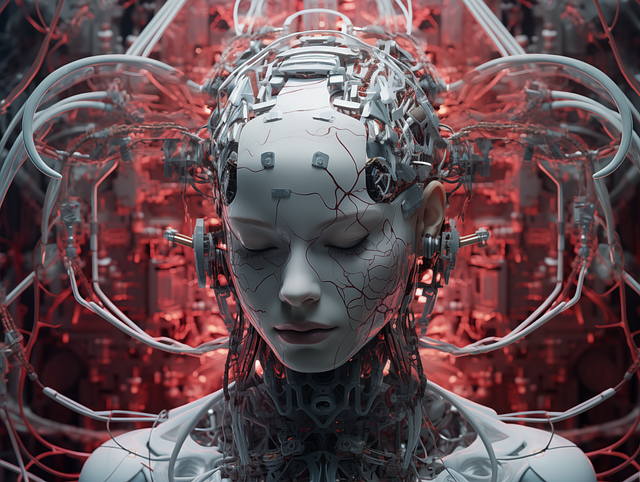

La Ética del Uso de Inteligencia Artificial en la Toma de Decisiones

El uso de inteligencia artificial (IA) en la toma de decisiones plantea importantes dilemas éticos que deben ser considerados por desarrolladores, empresas y gobiernos. Desde aplicaciones en la justicia hasta sistemas de contratación automatizada, la ética de la inteligencia artificial es clave para garantizar que estas tecnologías beneficien a la sociedad sin causar daño.

¿Qué Implica la Ética en la Inteligencia Artificial?

La ética en la IA se refiere a los principios y valores que guían el desarrollo y uso de esta tecnología. Incluye aspectos como la equidad, la transparencia y la responsabilidad. Las decisiones tomadas por sistemas de IA pueden tener un impacto significativo en las personas, lo que subraya la necesidad de un enfoque ético desde su diseño.

Principales Retos Éticos del Uso de Inteligencia Artificial

1. Sesgos Algorítmicos: Un Problema Ético Clave en la IA

Los algoritmos no son completamente objetivos; pueden reflejar los prejuicios presentes en los datos con los que son entrenados. Esto puede llevar a decisiones discriminatorias en áreas como la selección de personal, concesión de créditos o justicia penal.

Solución:

- Implementar auditorías regulares de los algoritmos.

- Utilizar conjuntos de datos diversos y representativos.

- Involucrar expertos en ética desde el inicio del desarrollo.

2. Transparencia y Explicabilidad en la Inteligencia Artificial

Uno de los mayores desafíos es entender cómo una IA llega a una decisión. La «caja negra» de algunos algoritmos hace difícil determinar si las decisiones son justas o adecuadas.

Solución:

- Apostar por modelos de IA explicables (XAI).

- Desarrollar herramientas que permitan auditar los procesos de toma de decisiones.

- Exigir regulaciones que promuevan la transparencia.

3. Privacidad y Protección de Datos

La toma de decisiones basada en IA a menudo requiere grandes cantidades de datos personales. Esto plantea preocupaciones sobre la privacidad, la seguridad de la información y el posible mal uso de los datos.

Solución:

- Cumplir con regulaciones como el GDPR (Reglamento General de Protección de Datos).

- Utilizar técnicas como la anonimización y el cifrado de datos.

- Restringir el acceso a los datos sensibles.

4. Responsabilidad en las Decisiones Automatizadas

Cuando un sistema de IA toma una decisión perjudicial, ¿quién es responsable? Esta es una de las preguntas más complejas en el debate ético sobre la inteligencia artificial.

Solución:

- Establecer marcos legales claros que asignen responsabilidades.

- Crear comités éticos en empresas y organizaciones que desarrollan IA.

- Desarrollar sistemas de IA con mecanismos de corrección y supervisión humana.

Casos Reales que Ejemplifican los Retos Éticos

- Sistema COMPAS en Estados Unidos: Un sistema de IA utilizado para evaluar el riesgo de reincidencia en procesos judiciales mostró sesgos raciales al tomar decisiones.

- Amazon y su IA de Reclutamiento: La herramienta desechó a candidatas mujeres debido a un sesgo en los datos históricos de contratación.

Estos casos resaltan la necesidad de aplicar la ética como componente central en el desarrollo y uso de IA.

Recomendaciones para un Uso Ético de la IA

- Establecer Principios Éticos en el Desarrollo de IA

Las empresas deben definir valores claros como la equidad, la transparencia y la inclusión desde la etapa de diseño. - Educación y Conciencia Ética

Capacitar a los desarrolladores y tomadores de decisiones sobre las implicaciones éticas de la IA es crucial para minimizar riesgos. - Promover la Supervisión Humana

La inteligencia artificial debe complementarse con la supervisión humana en decisiones críticas para evitar errores o abusos. - Impulsar Regulaciones Globales

Establecer normativas internacionales para garantizar que la IA se desarrolle y utilice de manera ética y responsable.

Conclusión: Construyendo un Futuro Ético con la Inteligencia Artificial

La ética del uso de inteligencia artificial en la toma de decisiones es un desafío global que requiere colaboración entre desarrolladores, reguladores y la sociedad. Adoptar un enfoque ético no solo evitará riesgos, sino que también fomentará la confianza en estas tecnologías, garantizando que su impacto sea positivo y equitativo.

Preguntas Frecuentes sobre la Ética de la Inteligencia Artificial

1. ¿Por qué es importante la ética en la IA?

Porque las decisiones automatizadas pueden tener un impacto significativo en las personas, especialmente en contextos sensibles como la justicia o la salud.

2. ¿Qué es un sesgo algorítmico?

Es la inclinación que tiene un sistema de IA a realizar decisiones influenciadas por datos históricos sesgados o no representativos.

3. ¿Cómo se puede garantizar la transparencia en la IA?

Adoptando modelos explicables y regulaciones que promuevan auditorías y supervisión en los procesos de IA.